Blog

KI Coding Tools im Vergleich: Was Enterprise-Entwickler wirklich wissen müssen

"Welches Tool sollen wir nehmen?" — ich höre diese Frage in fast jedem Erstgespräch. Und fast immer ist sie falsch gestellt. Nicht weil die Frage unwichtig wäre, sondern weil sie zu früh kommt. Bevor ein Team entscheidet, ob es GitHub Copilot, Claude Code, OpenAI Codex oder Gemini Code Assist einsetzt, muss es eine andere Frage beantworten: Wo genau in unserem Entwicklungsprozess soll KI eingreifen — und mit welchem Grad an Autonomie?

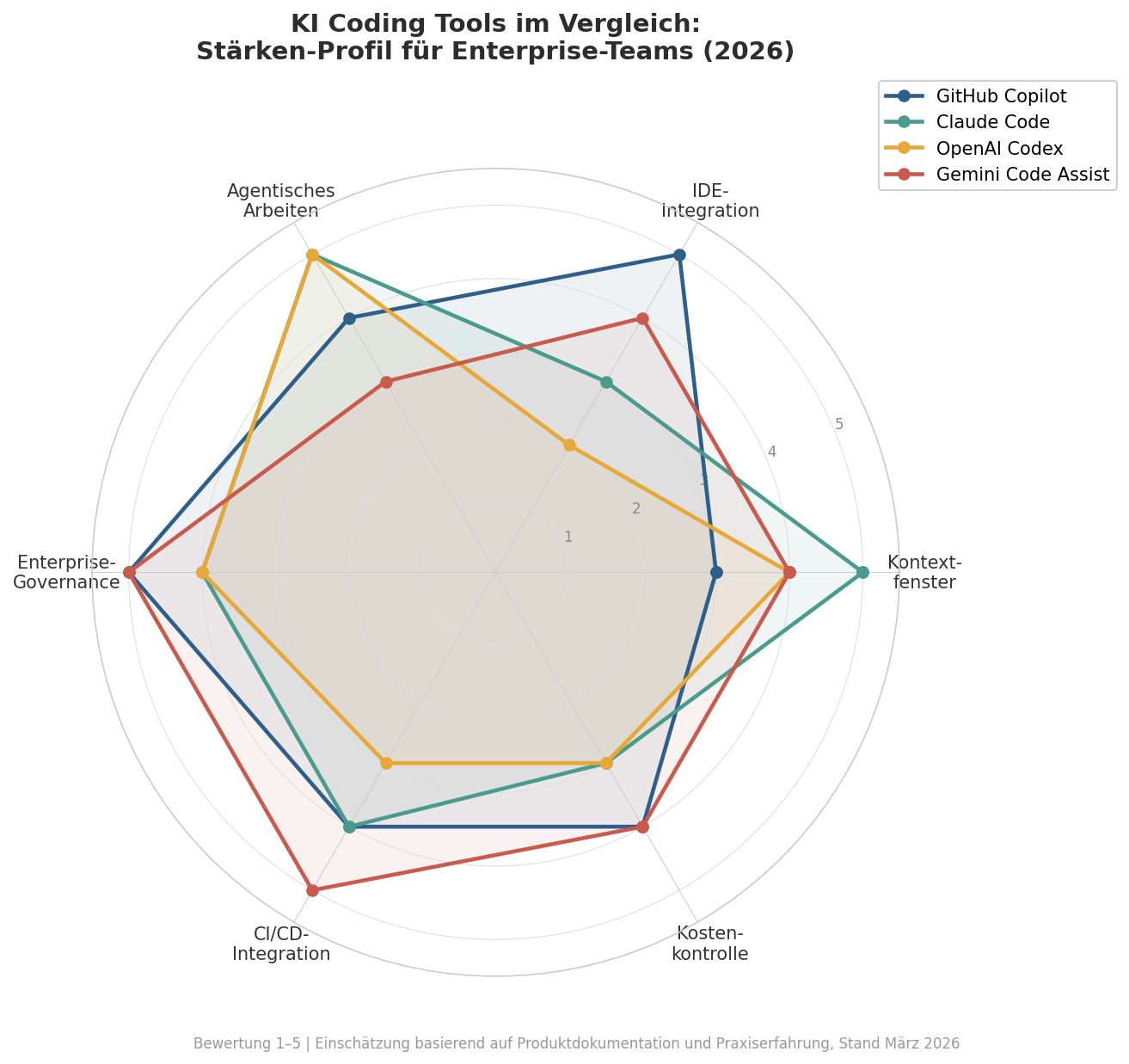

Die vier großen KI Coding Tools im Vergleich zu betrachten lohnt sich trotzdem, weil jedes davon eine grundsätzlich andere Philosophie verkörpert — und diese Philosophie bestimmt, für welche Art von Arbeit das jeweilige Tool taugt und für welche nicht.

Vier Tools, vier Architekturen

Was von außen nach vier austauschbaren Produkten aussieht, sind in Wahrheit vier sehr unterschiedliche Ansätze, KI in den Entwickleralltag zu integrieren. Der Unterschied liegt nicht in der Qualität der Codegenerierung — die ist mittlerweile bei allen vier auf einem hohen Niveau. Der Unterschied liegt in der Architektur der Interaktion: Wo sitzt das Tool, wie viel Kontext hat es, und wie autonom darf es handeln?

GitHub Copilot ist tief in die IDE eingebettet und genau dafür optimiert. Es lebt in VS Code, in JetBrains, in Neovim — überall dort, wo Entwickler ohnehin arbeiten. Die Stärke liegt in der Geschwindigkeit: Inline-Completions in Echtzeit, Tab drücken, weiterschreiben. Seit 2025 hat GitHub massiv in Richtung agentisches Arbeiten investiert. Der Agent Mode kann mittlerweile Änderungen über mehrere Dateien planen und umsetzen, und seit Februar 2026 lassen sich auch Claude und Codex als Agenten innerhalb von Copilot nutzen. Das Kontextfenster liegt bei 32.000 bis 128.000 Tokens — für die meisten Inline-Aufgaben ausreichend, für repo-weite Refactorings aber ein echtes Limit. Copilot Enterprise kostet 39 Dollar pro Nutzer und Monat und bietet dafür etwas, was kein anderes Tool in dieser Form hat: eine Knowledge Base, die auf euren internen Repositories trainiert, und ein zentralisiertes Management mit Audit-Logs, Policy-Kontrolle und SSO.

Claude Code kommt von der anderen Seite. Gestartet als reines Terminal-Tool, gibt es mittlerweile auch eine offizielle VS Code Extension mit über zwei Millionen Installationen. Die Grundidee bleibt aber dieselbe: Claude Code agiert wie ein eigenständiger Entwickler. Man gibt ihm eine Aufgabe, und es plant, implementiert, testet und iteriert — oft über Dutzende von Dateien gleichzeitig. Das Kontextfenster von bis zu einer Million Tokens ist dabei kein Marketing-Gimmick, sondern architektonisch notwendig: Wer einen Agenten auf ein ganzes Repository loslässt, braucht diese Menge an Kontext, damit das Ergebnis kohärent bleibt. Die eigentliche Killerfeature für Enterprise-Teams ist das Model Context Protocol (MCP), über das sich Claude Code mit mehr als 300 externen Systemen verbinden lässt — euer Ticket-System, eure Dokumentation, eure Datenbank, euer Monitoring. Claude Max kostet zwischen 100 und 200 Dollar pro Monat, je nach Nutzungsintensität, und richtet sich damit klar an Power-User, die das Tool stundenlang am Tag einsetzen.

OpenAI Codex verfolgt den radikalsten Ansatz unter den vieren. Im Kern arbeitet Codex mit isolierten Cloud-Sandboxes — jede Aufgabe läuft in einer eigenen Umgebung ohne Internetzugang, ein bewusster Sicherheitsmechanismus. Mittlerweile ist Codex aber nicht mehr nur über die ChatGPT-Oberfläche erreichbar: Eine eigene VS Code Extension (auch für Cursor, Windsurf und JetBrains) bringt Chat und Inline-Edits direkt in die IDE. Zusätzlich lässt sich Codex seit Februar 2026 als Agent innerhalb von GitHub Copilot nutzen. Das asynchrone Arbeitsmodell bleibt die Kernstärke — Aufgabe stellen, Agent arbeiten lassen, Ergebnis mit Logs und Testergebnissen reviewen. Seit GPT-5.3-Codex kann man sogar während der Ausführung eingreifen und nachsteuern. Das Preismodell über die API liegt bei 1,50 Dollar pro Million Input-Tokens, was bei intensiver Nutzung schnell unübersichtlich werden kann — Enterprise-Lizenzen mit festen Kosten liegen geschätzt bei 50 bis 60 Dollar pro Nutzer.

Gemini Code Assist ist Googles Antwort und das Tool mit der engsten Cloud-Integration. Wer bereits auf Google Cloud arbeitet, bekommt hier nahtlose Anbindung an Cloud Build, Cloud Run, BigQuery und den gesamten GCP-Stack. Das allein macht Gemini für GCP-native Teams zur naheliegenden Wahl — nicht weil die Codegenerierung besser wäre, sondern weil die Reibung am geringsten ist. Die Enterprise-Variante für 54 Dollar pro Nutzer und Monat erlaubt das Customizing auf Basis eurer eigenen Repositories, was die Qualität der Vorschläge in einem firmenspezifischen Kontext spürbar verbessert. Mit Gemini 2.5 Pro und der Einführung von Next Edit Predictions hat Google 2026 technisch aufgeholt, bleibt aber beim agentischen Arbeiten hinter Claude Code und Codex zurück.

Die eigentliche Entscheidung: Wie autonom darf der Agent sein?

Was in den meisten Vergleichsartikeln fehlt, ist die Frage, die für Enterprise-Teams tatsächlich entscheidend ist: Wie viel Kontrolle gebe ich ab? Die vier Tools bilden hier ein Spektrum.

Am einen Ende steht Copilot mit seinem Inline-Completion-Ansatz. Der Entwickler behält die Kontrolle über jede Zeile. Das Tool schlägt vor, der Mensch entscheidet. Das ist komfortabel und risikoarm, begrenzt aber den Produktivitätsgewinn auf den Bereich, in dem der Mensch ohnehin gerade arbeitet.

Am anderen Ende stehen Claude Code und Codex im agentischen Modus. Der Entwickler definiert eine Aufgabe, der Agent plant und implementiert eigenständig. Der Produktivitätsgewinn kann enorm sein — ein Feature, das normalerweise einen Tag dauert, steht nach zwanzig Minuten als PR bereit. Aber die Kontrolle verlagert sich: Statt Code zu schreiben, reviewt der Entwickler jetzt Code. Und zwar Code, den er nicht selbst geschrieben hat, der aber seinen Review-Standards standhalten muss.

Für regulierte Branchen — Finance, Automotive, Healthcare — ist diese Frage nicht akademisch. Wenn ein KI-Agent eine Änderung an einer sicherheitskritischen Komponente vornimmt, muss nachvollziehbar sein, wer die Änderung angestoßen hat, was der Agent getan hat und warum der Reviewer sie akzeptiert hat. Copilots Audit-Logging und Codex' isolierte Sandbox-Umgebung adressieren dieses Problem auf unterschiedliche Weise. Claude Codes Stärke liegt darin, dass der gesamte Gesprächsverlauf — inklusive Reasoning — dokumentiert ist. Gemini punktet mit der nativen GCP-Integration, die Compliance-Anforderungen über bestehende Cloud-Governance abdecken kann.

Was keines der Tools für euch löst

Die Wahrheit ist: Die Wahl des richtigen Tools ist wahrscheinlich die am wenigsten wichtige Entscheidung, die ihr in den nächsten sechs Monaten treffen werdet.

Der Grund ist simpel. Alle vier Tools sind gut genug, um einen erfahrenen Entwickler produktiver zu machen. Keines der vier ist gut genug, um einen unerfahrenen Entwickler zu ersetzen. Und keines löst das Problem, das die meisten Enterprise-Teams tatsächlich haben: fehlende Prozesse für den Umgang mit KI-generiertem Code.

Wer Copilot ausrollt, ohne vorher zu klären, wie KI-assistierte Pull Requests reviewed werden, hat nach drei Monaten ein Code-Qualitätsproblem. Wer Claude Code auf ein Legacy-System loslässt, ohne dem Agenten klare Boundaries zu setzen, hat nach einer Woche ein Refactoring-Chaos. Wer Codex in einer regulierten Umgebung einsetzt, ohne die Sandbox-Konfiguration zu verstehen, hat ein Audit-Problem.

Die Branchendaten sind hier eindeutig: Teams, die KI Coding Tools ohne Governance einsetzen, produzieren 1,7-mal so viele Issues und deutlich mehr Security Findings. Nicht weil die Tools schlecht sind, sondern weil die Prozesse fehlen.

Wie sich Teams für das richtige Tool entscheiden

Statt eine pauschale Empfehlung zu geben, arbeite ich in unseren Workshops mit den Teams heraus, wo ihre konkreten Engpässe liegen. Wer den Großteil der Zeit in der IDE verbringt und an einzelnen Dateien oder kleinen Modulen arbeitet, fährt mit Copilot am besten — es ist das Tool mit der geringsten Reibung im Tagesgeschäft. Wer dagegen regelmäßig große Refactorings stemmt, Legacy-Code migriert oder Testabdeckung für Altsysteme aufbauen muss, braucht die agentischen Fähigkeiten von Claude Code oder Codex.

Die Cloud-Infrastruktur spielt eine größere Rolle, als die meisten Teams erwarten. GCP-native Umgebungen harmonieren mit Gemini Code Assist so gut, dass allein die Pipeline-Integration den Ausschlag geben kann — unabhängig davon, wie die reine Codegenerierung im Benchmark abschneidet. Azure- und AWS-Teams haben mit Copilot oder Claude Code weniger Integrationsaufwand.

In regulierten Branchen dominieren zwei Faktoren die Entscheidung: Nachvollziehbarkeit und Isolation. Copilots Enterprise-Governance mit Audit-Logs liefert hier die ausgereifteste Antwort. Codex' Cloud-Sandbox schafft physische Isolation. Claude Codes MCP-Integrationen sind mächtig, erfordern aber sorgfältige Konfiguration — wer da nicht aufpasst, bindet versehentlich sensible interne Systeme an.

Beim Budget trennen sich die Welten deutlich: Copilot Business bei 19 Dollar pro Nutzer ist der günstigste Einstieg mit dem breitesten Feature-Set. Claude Code Max bei 100 bis 200 Dollar lohnt sich für Power-User, die das Tool stundenlang am Tag einsetzen. Codex' Token-basierte Abrechnung über die API kann bei unkontrollierter Nutzung schnell dreistellig werden.

Die meisten Teams, mit denen wir arbeiten, landen am Ende nicht bei einem Tool, sondern bei einer Kombination. Copilot für den Alltag in der IDE, Claude Code oder Codex für die großen Aufgaben. GitHub hat das erkannt und erlaubt seit Februar 2026, beide als Agenten innerhalb der Copilot-Oberfläche zu nutzen.

Warum ein Vergleichsartikel nicht reicht

Ich schreibe diesen Text, obwohl ich weiß, dass er ein grundsätzliches Problem hat: Er veraltet schnell. Die Feature-Sets dieser Tools ändern sich im Wochentakt. Was heute ein Unterscheidungsmerkmal ist, kann nächsten Monat Standard bei allen vier sein.

Was sich nicht so schnell ändert, sind die Workflows, die ein Team aufbaut. Wie reviewe ich agentisch generierten Code? Welche Quality Gates brauche ich in der Pipeline? Wie konfiguriere ich den Agenten, damit er unsere Architekturkonventionen einhält? Diese Fragen bleiben relevant, egal welches Tool gerade die beste Benchmark hat.

Und genau deshalb reicht ein Vergleich der KI Coding Tools allein nicht aus. Was Teams brauchen, ist jemand, der ihnen zeigt, wie man jedes dieser Tools in den eigenen Kontext einbettet — mit dem eigenen Code, den eigenen Prozessen und den eigenen Compliance-Anforderungen. Das ist keine Aufgabe für ein YouTube-Tutorial. Das ist eine Aufgabe für Leute, die diese Tools jeden Tag produktiv einsetzen und die Grenzen kennen, die kein Marketing-Material erwähnt.

Die Autoren von no-vibes() entwickeln seit über 15 Jahren aktiv im Enterprise-Umfeld — in Branchen wie Automotive, Finance und Healthcare. Sie beschäftigen sich nicht nur theoretisch mit Workflows, Pipelines und Use Cases, sondern erproben verschiedene Ansätze systematisch im Entwickler-Alltag und geben diese Erfahrungen in Trainings weiter.

Euer Team schneller mit KI-Tools machen?

Keine Hype-Trainings, sondern echte Techniken die funktionieren.

Erstgespräch buchen →